安装配置

安装配置

# 安装配置

企业GPT是使用爱招飞软件开发制作的工具模板。所有的管理配置页面均使用爱招飞的网页开发工具 FastWeb (opens new window) 制作。

企业GPT为模板,使用模板需安装前置的开发环境,列表如下:

| 环境需求 | 说明 |

|---|---|

| FastWeb (opens new window) | 设备最佳运行效益页面 |

# 1. 基础环境配置

企业GPT基础环境包括数据库、FastWeb服务端。请按照以下顺序进行设置安装。

# 1.1. 数据库导入

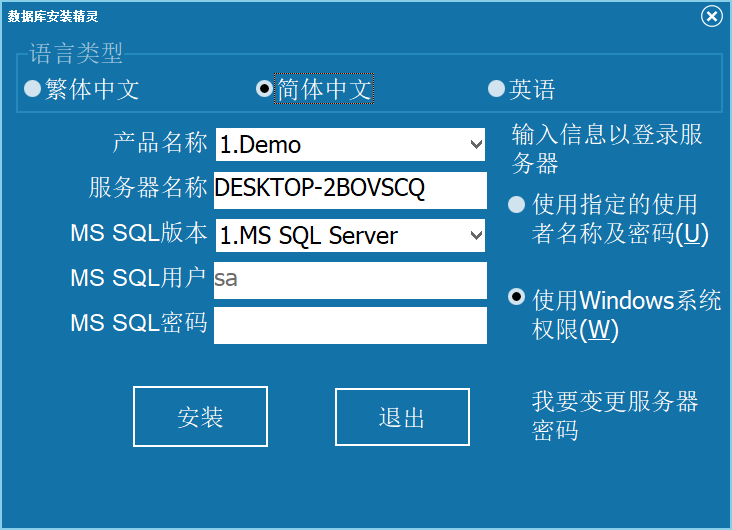

数据库环境使用 FastWeb的示例数据库 demo,默认数据库示例中已包含相关表结构。需提前设置安装数据库管理系统 (opens new window)与示例数据导入 (opens new window),使用DB_Install导入时产品名称请选择 demo。安装完成 demo 后,再选择产品名称 Frame 进行安装。

# 1.2. FastWeb 设置

FastWeb 是 WEB 服务端,提供 WebSocket 连接的支持。轨迹追踪的网页模板来源于 FastWeb 的 IsoBean。FastWeb 的安装请参考 FastWeb安装配置 (opens new window)。FastWeb中提供了相关的支持。

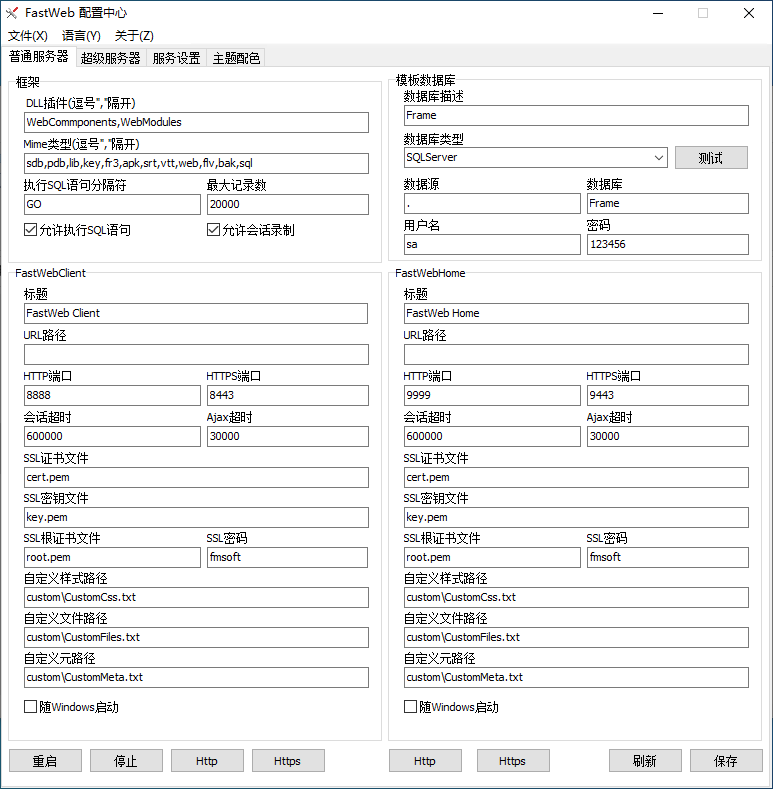

如果您完全按照安装数据库管理系统 (opens new window)的方式进行安装,则可直接运行 FastWeb;如果您在安装数据库管理系统的过程中自行指定了其他用户名密码,则在安装完成后,打开安装目录下的 ConfigTool.exe ,修改框架数据库中的数据源为数据库服务器地址,同时修改用户名、密码信息。

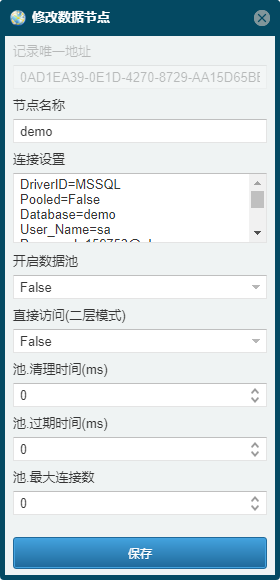

FastWeb 使用的 demo 数据库通过 Node节点数据库 (opens new window) 连接,如果您完全按照安装数据库管理系统 (opens new window)的方式进行安装,此处不需要进行修改,如果您在安装数据库管理系统时自行指定了其他用户名与密码信息,请修改节点数据库中 demo 的连接信息,需要修改的项目为数据库服务器地址,用户名、密码信息。其中的 连接设置 可通过双击编辑框进行修改。

双击 连接设置 编辑框,打开 数据库连接设置 对话框,根据实际情况修改 User_Name(用户名)、Password(密码) 与 Server(服务器地址) ,修改完成后,可点击 [测试] 按钮测试确认连接设置是否填写正确,填写确认无误后,点击 [OK] 按钮返回修改数据库节点对话框,点击 [保存] 按钮保存。

# 2. 企业GPT服务端设置

企业GPT服务端仅支持在Linux 系统中运行,本系统在Debian12 中已经过运行验证。企业GPT运行有最低需求限制,具体要求如下:

| 需求格式 | 语言模型服务 | 企业GPT应用服务 |

|---|---|---|

| 显卡显存 | 至少24GB | 至少16GB |

| 内存 | 至少32GB | 至少32GB |

# 2.1. 文件说明

企业GPT服务端的程序文件使用网盘提供,请点击此处 (opens new window)打开网页自行下载。

以下是企业GPT服务的运行架构示意图。

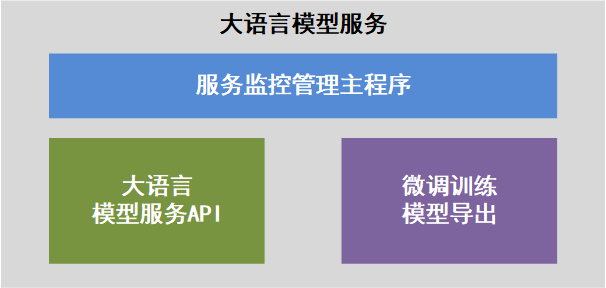

以下是大语言模型运行的示意图。

# 2.2. 基础环境配置

以下以Debian 12为例,说明基础环境的配置方式。

使用以下命令安装基础运行环境。

# 安装CUDA运行环境

sudo apt install nvidia-driver

# 安装CUDA 开发套件

sudo apt install nvidia-cuda-toolkit

# 安装音频相关组件

sudo apt install ffmpeg libavcodec-extra

# 安装版本管理系统

sudo apt install git git-lfs

# 初始化版本管理环境

git lfs install

2

3

4

5

6

7

8

9

10

# 2.3. 合成压缩包

下载并解压缩文件。

tar zxvf smegpt.tar.gz

解压缩后的程序文件位于 smegpt 目录中。

# 2.4. 安装基础环境

执行安装包中的运行脚本 init_conda.sh,初始化运行环境。

sh ./init_conda.sh

# 2.5. 检查设置

设置项位于 config.ini 文件中。根据您实际使用模块的情况配置对应的设置项。

# 2.5.1. 基础设置

请在config.ini 中找到相关的设置,并修改为实际使用的地址。

[LLM]

# 语言模型的基础设置

# 设置自定义的模型API地址,如果使用本地模型API,则需要设置这些项目

OPENAI_API_BASE = http://192.168.0.231:8000/v1

# 设置OpenAI API Key,如不使用OpenAI 的 API,此项可任意填写

OPENAI_API_KEY = BLUE

# 选择使用的LLM 模型名称

LLM_MODEL = gpt-3.5-turbo

# 是否选择启用本地model

LOCAL_MODEL = true

[FastWeb]

# FastWeb 相关设置,设置FastWeb HTTP服务地址

FASTWEB_URL = http://192.168.0.201:8803/

[WebSocket]

# WebSocket 连接设置,请设置为 FastWeb WebSocket 地址

WS_SERVER = ws://192.168.0.201:8805/message

# 主线程的运行id,请严格按照以下方式设置

# 如本服务作为语言模型服务以及微调训练服务使用,请将 sid 设置为 main_llm

# 如本服务作为应用服务使用,请将 sid 设置为 main_websocket

# 如果在同一个服务器中搭建,请将此项目复制为多个,分别运行

WS_MAIN_SID = main_websocket

WS_GPTBOT_SID = gpt_bot

[Application]

# 应用程序地址设置

# 如果 gpt bot app path 中没有 py 字样的内容,表示是以程序的方法启动

GPT_BOT_APP_PATH = ./gpt_bot_main

# 设置是否自动启动GPT_BOT 服务

GPT_BOT_AUTOSTART = True

GPT_BOT_HOST = 0.0.0.0

GPT_BOT_PORT = 8100

GPT_BOT_REMOTE_SERVER = http://192.168.0.146:8100

# 如果 wechat app path 中没有 py 字样的内容,表示是以程序的方法启动

WECHAT_BOT_APP_PATH = ./wechat_service

WECHAT_BOT_WORK_PATH = /

# 如果 line app path 中没有 py 字样的内容,表示是以程序的方法启动

LINE_BOT_APP_PATH = ./line_service

LINE_BOT_WORK_PATH = /

FINE_TUNE_APP_PATH = ./train_bash

FINE_TUNE_WORK_PATH = /

EXPORT_MODEL_APP_PATH = ./export_model

EXPORT_MODEL_WORK_PATH = /

# 如果 voice app path 中没有 py 字样的内容,表示是以程序的方法启动

VTTS_APP_PATH = ./voice_tts_service

# 是否自动启动服务VTTS服务

VTTS_AUTOSTART = True

# LLM 服务应用目录

llm_api_app_path = ./app

llm_api_work_path = /

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

# 2.6. 运行

使用以下命令执行运行:

sh ./start.sh

命令行输入后会转入后台运行,命令行中不会出现任何提示,可在程序运行目录 log/ 文件夹下查看运行输出的信息。